Sahte videolara teknolojik çözüm

“Deepfake” ile yüzler başka insanların yüzleriyle değiştiriliyor ve ağızlarından hiç söylemedikleri sözler çıkarılıyor. Bu, dolandırıcılık ve şantaj girişimlerinde kullanıldığı gibi siyasi amaçlarla da kötüye kullanılabiliyor. Ama bilim insanları en küçük sapmaları bile tanıyan, algoritmalara dayanan bir sistem geliştirerek bu “sahte yüzler” sorununu çözmek üzere.

Sosyal davranışımız için çevremizdeki insanların yüzlerini birbirinden ayırt edebilmemiz ve hatırlamamız çok önemli. İyi bir yüz tanıma yetisine sahibiz ve beynimizde yüz tanımadan sorumlu özel bölgeler var. Tek bakışla karşımızdaki kişinin tam olarak kim olduğunu biliriz. Fakat yeni teknolojiler işimizi zorlaştırdı. Çünkü bazı durumlarda videodaki bir yüz, gerçek hayattaki sahibi olmayabiliyor. “Deepfake” olarak isimlendirilen sistemle, yüzler başka insanların yüzleriyle değiştirilip ağızlarından hiç söylemedikleri sözcükler çıkarılıyor. Bu tür sahtekârlıklar, dolandırıcılık ve şantaj girişimlerinde kullanıldığı gibi siyasi amaçlarla da kötüye kullanılabiliyor. Örneğin sahte bir videoyla, Berlin, Madrid ve Viyana belediye başkanları, Kiev Belediye Başkanı Vitali Kliçko ile bir video konferansı yaptıklarına inandırıldı. Teknolojiler geliştikçe bu tür sahte videolar daha “gerçekçi” olmaya başlayacak ve bizim bunları anlamamız da gitgide zorlaşacak. Bu yüzden sahte videoları anlamak için farklı teknolojiler kullanılıyor. Örneğin sahte ağız hareketleri veya yüzlerin yerleştirilmesi sırasında oluşan çizgiler aranıyor. Ayrıca kişinin gerçek olup olmadığını anlamak için biyometrik karşılaştırmalar da yapılıyor. Fakat bunu yapabilmek için kişinin özelliklerinin önceden kaydedilip değerlendirilmesi gerekiyor.

GÖRÜNTÜLER ANALİZ EDİLİYOR

Kaliforniya Üniversitesi’nden Hany Farid ve Prag Kepler, Gymnasium’dan Matyas Bohacek’e göre kimlik bazlı yöntem en mantıklısı ve en sağlam yaklaşım. Öğrenebilir bir algoritmayla araştırmacılar bu tür bir sistem geliştirdi ve bunu Zelenski’nin videosuyla test ettiler. İlk önce Zelenski’nin halka yaptığı konuşmaları, basın toplantılarını ve video mesajlarını gösteren 506 dakikalık görüntüleri analiz ettiler. Araştırmacılara göre bu tür analizler için en azından sekiz saatlik bir video materyali gerekiyor. Bu analizlerden Ukrayna devlet başkanını karakterize eden 780 özellikli bir dizi ortaya çıktı. Bu özellikleri temel alan algoritmalar dört sahte videoyu ve 250 kişiyi yüzde 99.9’luk bir doğruluk payıyla ayırt edebildi. Zelenski’nin tanımlanmış özellikleri arasında, tanımlamanın doğruluğuna tek başına yüzde 10’dan fazla katkıda bulunan bazı özellikler de var. Örneğin başkanın en dikkat çekici özelliği konuşurken sol elini kullanırken sağ elinin aşağıda kalması. Farid ve Bohacek bu yüzden “Deepfake” sahtekârlıklarını ortaya çıkarabilmek için siyaset ve kamusal alandaki önemli kişiler için bu tür test modelleri oluşturmanın yararlı ve umut verici olduğunu düşünüyor.

- Protecting world leaders against deep fakes using facial, gestural, and vocal mannerisms, PNAS, 23.11.2022

En Çok Okunan Haberler

-

Gram altında zirve için rakam verildi

Gram altında zirve için rakam verildi

-

İmamoğlu'ndan Edanur açıklaması

İmamoğlu'ndan Edanur açıklaması

-

Cumhuriyet'e açıkladılar: İmamlık yapıyordu

Cumhuriyet'e açıkladılar: İmamlık yapıyordu

-

AKP İstanbul'u kapatıyor!

AKP İstanbul'u kapatıyor!

-

Murat Kurum'a 'yeni görev' iddiası

Murat Kurum'a 'yeni görev' iddiası

-

Kadıköy’de Tacettin Kutay'ın kızına sözlü taciz iddiası

Kadıköy’de Tacettin Kutay'ın kızına sözlü taciz iddiası

-

'Ferdi Tayfur' videosuna ilişkin açıklama

'Ferdi Tayfur' videosuna ilişkin açıklama

-

Acun Ilıcalı yeni takımını duyurdu

Acun Ilıcalı yeni takımını duyurdu

-

Tolunay Kafkas'tan Galatasaray sözleri

Tolunay Kafkas'tan Galatasaray sözleri

-

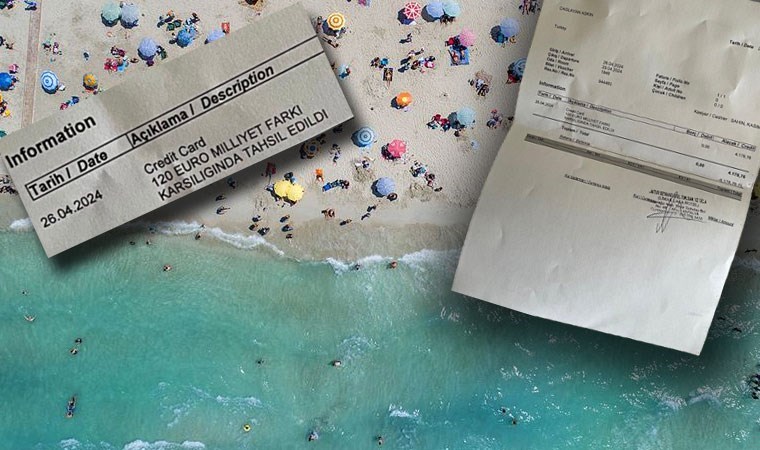

'Milliyet farkı' ödemesi alan otelin cezası belli oldu

'Milliyet farkı' ödemesi alan otelin cezası belli oldu