Yakın zamanda hakemli bilimsel dergi Plos One'da yayımlanan araştırmada 436 kişilik bir gruba popüler filmlere deepfake'le başka oyuncuların eklendiği videolar izletildi.

Bunlar arasında Brad ve Pitt ve Angelina Jolie'nin yer aldığı bir The Shining kesiti, Charlize Theron'un yüzünün yerleştirildiği Captain Marvel ve Will Smith'in Neo'yu canlandırmış gibi göründüğü The Matrix videoları vardı.

Tümünde oyuncuların yüzleri film kesitlerine deepfake teknolojisiyle yerleştirilmişti.

Katılımcılara ayrıca gerçekten var olan yeni çevrim filmler de izletildi.

Independent Türkçe'de yer alan habere göre bulgular, katılımcıların ortalama yüzde 49'unun deepfake videoların gerçek olduğuna inandığını gösterdi. Bu katılımcılar filmleri gerçekten hatırladığını ileri sürüyordu.

Hatta yüzde 41'i Captain Marvel'ın yeniden çevriminin orijinalinden daha iyi olduğunu söylerken, yüzde 12'si de The Matrix'in yeniden çevrimini daha iyi bulduğunu dile getirdi.

İrlanda'daki University College Cork'tan yanlış bilgi araştırmacısı Gillian Murphy, "Gelişmekte olan teknolojilerle ilgili korkularımıza dayanarak distopik gelecek tahminlerine hemen dalmamalıyız" dedi.

Aynı zamanda araştırmanın başyazarı olan Murphy, DailyBeast'e verdiği röportajda şu ifadeleri kullandı:

Evet, deepfake'in neden olduğu çok ciddi zararlar var. Ancak var olabileceğini varsaydığımız sorunları çözmek için acele etmeden önce, her zaman ilk etapta bu zararlara dair kanıt toplamalıyız.

Öte yandan araştırmacılar, deepfake'in ekstra bir tehlike oluşturmayablileceği görüşünde.

Zira deneyin ikinci etabında deepfake'li görüntüler yerine katılımcılara metinler verildi. Bu metinlerde de ünlü filmlerin hiç çekilmemiş yeniden çevrimleri ve bu filmlerde hiç oynamamış oyuncuların isimleri geçiyordu.

Bu yazılı tariflerin de katılımcıların önemli bir kısmında sahte anılar canlandırabildiği görüldü.

Murphy, "Bulgularımız, mevcut yanlış bilgi biçimlerinin ötesinde, benzersiz derecede güçlü bir deepfake tehdidi önermiyor" diye konuştu.

Öte yandan araştırmacı, bu çalışmada yalnızca kısa süreli belleğe odaklandıklarını da sözlerine ekledi:

Deepfake'ler yanlış bilgi yaymak için daha güçlü bir araç olabilir, çünkü örneğin viral olma olasılıkları daha yüksek veya uzun vadede daha akılda kalıcı.

Deepfake nedir?

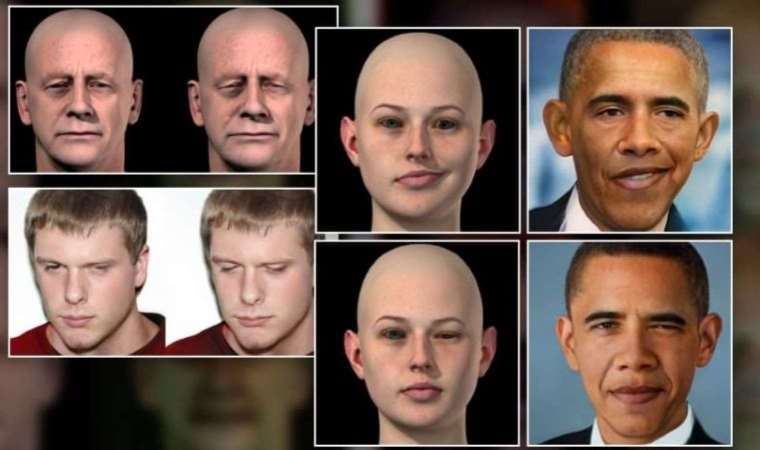

Türkçedeki birebir sözcük karşılığı "derin sahte" olan deepfake kabaca birinin yüzünü dijital olarak başka birinin vücuduna monte edip elde ettiğiniz görüntüyü istediğiniz gibi kullanmanıza olanak tanıyan bir teknoloji. Kısacası internetten kolayca ulaşılabilen algoritmalar sayesinde A kişisinin yüzü B kişisine montajlanabiliyor.

İnternet kullanıcıları, deepfake içeriğe ilk kez 2017'de maruz kaldı. O yıl anonim bir Reddit kullanıcısı, Scarlett Johansson gibi ünlülerin deepfake'le oluşturulmuş sahte pornografik görüntülerini yayımlamıştı.

Yapay zeka algoritmalarının sağlam bir deepfake örneği oluşturabilmesi için bol miktarda video kaydı gerekiyor. Bu da internet ortamında çok sayıda görüntüsü olan ünlülerle daha gerçekçi deepfake'ler oluşturulmasını sağlıyor.